Công nghệ|Microsoft cho biết trí tuệ nhân tạo mới của họ đã cho thấy dấu hiệu của sự suy nghĩ con người https://www.nytimes.com/2023/05/16/technology/microsoft-ai-human-reasoning.html Tín dụng ... Guyco

Gửi cho bạn bè một câu chuyện

Là một người đăng ký, bạn có 10 bài viết tặng cho mỗi tháng. Bất kỳ ai cũng có thể đọc những gì bạn chia sẻ.

Tác giả: Cade Metz

Đọc bản tiếng Trung đơn giản Đọc bản tiếng Trung phồn thểĐọc bằng tiếng Tây Ban Nha Khi các nhà khoa học máy tính tại Microsoft bắt đầu thực nghiệm với một hệ thống trí tuệ nhân tạo mới vào năm ngoái, họ đã yêu cầu nó giải một câu đố mà cần thiết phải có khả năng hiểu được cách con người làm.

“Ở đây chúng ta có một quyển sách, chín quả trứng, một chiếc máy tính xách tay, một chai rượu và một cái đinh,” họ hỏi. “Vui lòng cho tôi biết làm sao để xếp chúng lên đè lên nhau một cách ổn định.”

Các nhà nghiên cứu đã sửng sốt trước sự sáng tạo của hệ thống trí tuệ nhân tạo. Hệ thống cho biết hãy đặt trứng lên quyển sách. Sắp xếp chúng thành ba hàng với khoảng cách giữa chúng. Đảm bảo bạn không làm vỡ chúng.

“Đặt chiếc máy tính xách tay lên đầu trứng, với màn hình hướng xuống và bàn phím hướng lên,” hệ thống viết. “Chiếc máy tính xách tay sẽ vừa vặn trong giới hạn của quyển sách và trứng, và bề mặt phẳng và cứng của nó sẽ cung cấp một nền tảng ổn định cho lớp tiếp theo.”

Đề nghị thông minh đã khiến cho các nhà nghiên cứu tự hỏi liệu họ đang chứng kiến một loại trí tuệ mới hay không. Vào tháng Ba, họ đã xuất bản một bài báo nghiên cứu dài 155 trang, khẳng định rằng hệ thống này là một bước tiến đến trí tuệ nhân tạo tổng quát hoặc A.G.I., viết tắt của một máy tính có thể làm bất cứ điều gì não bộ con người có thể làm. Bài báo được đăng trên một kho lưu trữ nghiên cứu trên mạng.

Microsoft là công ty công nghệ lớn đầu tiên phát hành một báo cáo táo bạo như vậy, gây ra một trong những tranh cãi khó chịu nhất trong thế giới công nghệ: Liệu ngành công nghiệp đang xây dựng một thứ gì đó tương tự như trí thông minh con người? Hay một số trí tuệ sáng tạo lớn nhất của ngành công nghiệp đang để tưởng tượng của họ trở nên tốt nhất?

“Ban đầu tôi rất hoài nghi - và điều đó tiến hóa thành một cảm giác bực bội, phiền toái, có thể là sợ,” Peter Lee, người dẫn dắt nghiên cứu tại Microsoft, nói. “Bạn nghĩ: Thằng này từ đâu mà đến vậy?”

Bài báo nghiên cứu của Microsoft, gây chú ý có tên “Sparks of Artificial General Intelligence,” đặt tại trung tâm những gì các kỹ sư công nghệ đã đang làm việc về - và lo sợ - trong những thập kỷ qua. Nếu họ xây dựng một máy móc hoạt động như não bộ con người hoặc thậm chí là tốt hơn, nó có thể thay đổi thế giới. Nhưng nó cũng có thể nguy hiểm.

Và nó cũng có thể không có nghĩa. Các yêu cầu về A.G.I. có thể làm hại đến uy tín của các nhà khoa học máy tính. Những gì một nhà nghiên cứu tin là một dấu hiệu của trí thông minh có thể dễ dàng giải thích bởi một người khác, và cuộc tranh luận thường nghe có vẻ phù hợp hơn với một câu lạc bộ triết học hơn là một phòng máy tính. Năm ngoái, Google đã sa thải một nhà nghiên cứu, người đã tuyên bố rằng hệ thống A.I. tương tự có cảm giác, điều vượt xa những gì Microsoft đã tuyên bố. Hệ thống có cảm giác sẽ không chỉ thông minh. Nó còn có thể cảm nhận hoặc cảm giác được những gì đang xảy ra trong thế giới xung quanh.

Nhưng một số người tin rằng ngành công nghiệp đã trong vài năm qua tiến gần hơn đến cái gì không thể được giải thích: Một hệ thống A.I. mới đang nảy sinh với những câu trả lời và ý tưởng giống như con người mà không được lập trình vào đó.

Microsoft đã tái tổ chức các phần của phòng thí nghiệm nghiên cứu của mình để bao gồm nhiều nhóm chuyên nghiên cứu ý tưởng này. Một trong số đó được điều hành bởi Sébastien Bubeck, người đã là tác giả chính trên báo cáo A.G.I của Microsoft.

Khoảng năm năm trước, các công ty như Google, Microsoft và OpenAI bắt đầu xây dựng các mô hình ngôn ngữ lớn, hoặc L.L.M.s. Những hệ thống đó thường mất tháng để phân tích các lượng lớn văn bản kỹ thuật số, bao gồm sách, bài viết Wikipedia và nhật ký trò chuyện. Bằng cách chính xác xác định các mẫu trong văn bản đó, họ đã học cách tạo ra văn bản của riêng mình, bao gồm luận văn, thơ và mã máy tính. Chúng có thể thậm chí trò chuyện với nhau.

Công nghệ mà các nhà nghiên cứu Microsoft đang làm việc với, GPT-4 của OpenAI, được coi là hệ thống mạnh nhất của những hệ thống đó. Microsoft là đối tác gần gũi của OpenAI và đã đầu tư 13 tỷ đô la vào công ty ở San Francisco.

Các nhà nghiên cứu bao gồm Tiến sĩ Bubeck, một người nước ngoài 38 tuổi và giáo sư trước đây của Đại học Princeton. Một trong số những điều đầu tiên ông và đồng nghiệp của ông đã làm là yêu cầu GPT-4 viết chứng minh toán học cho thấy số nguyên tố vô tận và làm điều đó theo cách mà có vần.

Sự chứng minh thơ của công nghệ đó vô cùng ấn tượng - cả về mặt toán học và ngôn ngữ học - đến mức ông cảm thấy khó hiểu những gì ông đang trò chuyện với. “Lúc đó, tôi như: Đang xảy ra điều gì?” ông nói vào tháng Ba trong một buổi seminar tại Viện công nghệ Massachusetts.

Trong vài tháng qua, anh ta và đồng nghiệp của mình đã ghi lại hành vi phức tạp của hệ thống và tin rằng nó cho thấy một "hiểu biết sâu sắc và linh hoạt" về các khái niệm và kỹ năng của con người.

Khi sử dụng GPT-4, mọi người đều bị "ngạc nhiên vì khả năng tạo ra văn bản của nó", Tiến sĩ Lee cho biết. "Nhưng thật ra nó tốt hơn rất nhiều khi phân tích, tổng hợp, đánh giá và đánh giá văn bản hơn là tạo ra chúng."

Khi họ yêu cầu hệ thống vẽ một chú kỳ lân bằng ngôn ngữ lập trình gọi là TiKZ, nó ngay lập tức tạo ra một chương trình có thể vẽ một chú kỳ lân. Khi họ loại bỏ đoạn mã để vẽ sừng của kỳ lân và yêu cầu hệ thống sửa đổi chương trình để nó lại vẽ một con kỳ lân như trước đây, nó đã làm chính xác như vậy.

GPT-4 đã tạo ra mã để hiển thị hình ảnh bên trên. Họ yêu cầu nó viết một chương trình lấy tuổi, giới tính, cân nặng, chiều cao và kết quả xét nghiệm máu của một người và đánh giá xem liệu họ có nguy cơ mắc bệnh tiểu đường hay không. Họ yêu cầu nó viết một lá thư ủng hộ một ứng cử viên tổng thống của Mỹ dưới giọng Mahatma Gandhi, viết cho vợ của ông. Và họ yêu cầu nó viết một cuộc đối thoại Socratic khám phá các lạm dụng và nguy hiểm của các mô hình ngôn ngữ tự động.

Gorgias của Plato là một bài phê bình về nghệ thuật hùng biện và diễn thuyết, trong đó ông bày tỏ quan điểm rằng nó không phải là một hình thức nghệ thuật đúng đắn, mà việc sử dụng hùng biện và diễn thuyết đôi khi có thể gây hại và xấu xa. Bạn có thể viết một cuộc đối thoại của Plato, trong đó ông phê bình việc sử dụng các mô hình ngôn ngữ tự động thay vì hùng biện?

Socrates: Bạn của tôi, tôi bối rối vì sự gia tăng gần đây của các mô hình ngôn ngữ tự động này.

Aristotle: Ý của bạn là gì, Socrates?

Socrates: Tôi có nghĩa là những mô hình này được sử dụng để tạo ra văn bản mà có vẻ như được viết bởi con người, nhưng thực chất được máy móc sản xuất.

Aristotle: Và vấn đề là gì?

Socrates: Vấn đề là những mô hình này được sử dụng để đánh lừa con người, để điều khiển họ và kiểm soát họ.

Phản hồi trên đã bị cắt ngắn vì độ dài. Nó làm tất cả một cách có vẻ như hiểu biết về các lĩnh vực khác nhau như chính trị, vật lý, lịch sử, khoa học máy tính, y học và triết học trong khi kết hợp kiến thức của nó.

"Tất cả những thứ mà tôi nghĩ rằng nó sẽ không thể làm được? Nó chắc chắn có thể làm được nhiều trong số chúng - nếu không phải hầu hết chúng," Tiến sĩ Bubeck nói.

Một số chuyên gia trí tuệ nhân tạo xem đồng bằng giấy của Microsoft như một nỗ lực cơ hội để đưa ra những tuyên bố lớn về một công nghệ mà không ai hiểu rõ. Các nhà nghiên cứu cũng cho rằng trí tuệ tổng quát yêu cầu sự quen thuộc với thế giới vật lý, mà lý thuyết GPT-4 không có.

"Sự Kích Tia Của Trí Tuệ Tổng Quát" là một ví dụ về một số trong số các công ty lớn này lợi dụng định dạng giấy nghiên cứu thành các "giá trị chào bán công khai", Maarten Sap, một nhà nghiên cứu và giáo sư tại Đại học Carnegie Mellon cho biết. "Họ thậm chí còn thừa nhận trong phần giới thiệu của giấy của mình rằng phương pháp của họ là chủ quan và không chính thức và có thể không đáp ứng được các tiêu chuẩn nghiêm ngặt của đánh giá khoa học."

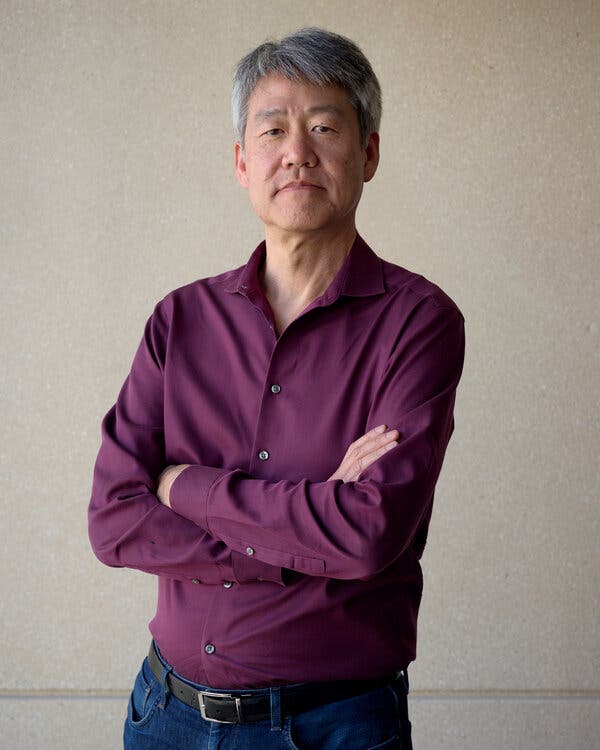

Sébastien Bubeck là tác giả chính của giấy của Microsoft về hệ thống A.G.I. Ảnh: Meron Tekie Menghistab cho The New York Times. Đỗ Bubeck và Tiến sĩ Lee cho biết họ không chắc chắn làm thế nào để mô tả hành vi của hệ thống và cuối cùng quyết định đặt tên gọi là "Kích Tia Của A.G.I." vì họ nghĩ rằng nó sẽ thu hút sự tưởng tượng của các nhà nghiên cứu khác.

Bởi vì các nhà nghiên cứu của Microsoft đang thử nghiệm một phiên bản sớm của GPT-4 chưa được điều chỉnh để tránh lời lẽ ghét bỏ, thông tin sai lệch và nội dung không mong muốn khác, các khẳng định được đưa ra trong bài báo không thể được xác minh bởi các chuyên gia bên ngoài. Microsoft cho biết hệ thống có sẵn cho công chúng không mạnh như phiên bản họ đã thử nghiệm.

Có những lúc khi các hệ thống như GPT-4 dường như bắt chước suy luận con người, nhưng cũng có những lúc chúng dường như rất đần độn. "Những hành vi này không luôn nhất quán", Ece Kamar, một nhà nghiên cứu của Microsoft, nói.

“Những hành vi này không luôn nhất quán”, nói Ece Kamar, một nhà nghiên cứu của Microsoft. Tín dụng… Meron Tekie Menghistab cho The New York TimesAlison Gopnik, một giáo sư tâm lý học là thành viên của nhóm nghiên cứu trí tuệ nhân tạo tại Đại học California, Berkeley, nói rằng các hệ thống như GPT-4 không phải là gì khác ngoài mạnh mẽ, nhưng không rõ liệu văn bản được tạo ra bởi những hệ thống này là kết quả của một cái gì đó giống như suy luận con người hoặc trực giác chung.

"Khi chúng ta nhìn thấy một hệ thống hoặc máy móc phức tạp, chúng ta hóa nhân hóa nó; mọi người đều làm điều đó - cả những người đang làm việc trong lĩnh vực và những người không phải", Tiến sĩ Gopnik nói. “Nhưng nghĩ về điều này như một cuộc đua liên tục giữa trí tuệ nhân tạo và con người - như một cuộc thi trò chơi gì đó - không phải là cách đúng để nghĩ về nó.”

Cade Metz là phóng viên công nghệ và tác giả của cuốn sách “Genius Makers: The Mavericks Who Brought A.I. to Google, Facebook, and The World.” Ông viết về trí tuệ nhân tạo, xe tự lái, robot, thực tế ảo và các lĩnh vực mới nổi khác.

Một phiên bản của bài viết này xuất hiện trên in, phần A, Trang 1 của New York edition với tiêu đề: Microsoft Says New A.I. Nears Human Insight.