Trước khi Elon Musk và cộng sự Steve Wozniak, người sáng lập công ty Apple, ký thư cảnh báo rằng trí tuệ nhân tạo đặt ra "những mối nguy hiểm đáng kể" đối với nhân loại, nhà vật lý lý thuyết người Anh Stephen Hawking đã cảnh báo về công nghệ đang phát triển với tốc độ nhanh chóng.

"Việc phát triển trí tuệ nhân tạo hoàn toàn có thể dẫn đến sự tiêu diệt loài người," Hawking nói với BBC trong một cuộc phỏng vấn vào năm 2014.

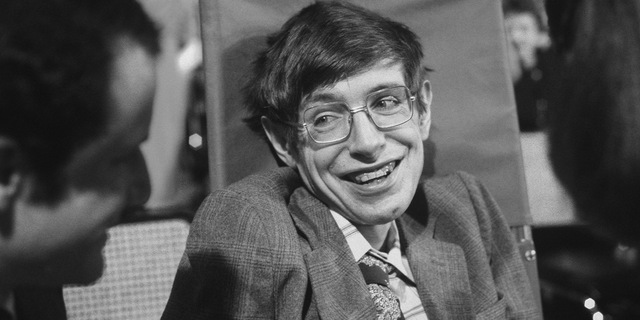

Hawking đã mắc bệnh bại liệt cơ bắp đốt sống đáy hơn 55 năm, và ông qua đời vào năm 2018 khi mới 76 tuổi. Mặc dù ông đã có những lời phê bình về trí tuệ nhân tạo, ông cũng đã sử dụng một hình thức cơ bản của công nghệ này để truyền đạt do bệnh tật của mình, khiến các cơ bắp yếu đi và yêu cầu Hawking sử dụng xe lăn.

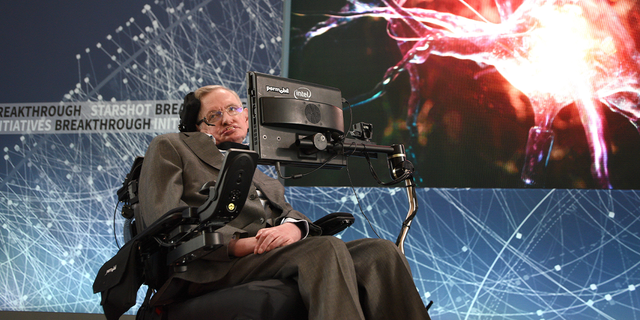

Năm 1985, Hawking đã không còn nói được và phải dựa vào nhiều cách thức khác nhau để truyền đạt, bao gồm một thiết bị tạo ra giọng nói do Intel sản xuất, cho phép ông sử dụng các chuyển động khuôn mặt để lựa chọn từ hoặc kí tự được tổng hợp thành giọng nói.

Trả lời một câu hỏi về việc tái cơ cấu công nghệ giọng nói mà ông phải dựa vào, lời nhận xét của Hawking với BBC vào năm 2014 rằng trí tuệ nhân tạo có thể "dẫn đến sự tiêu diệt loài người". Ông cho biết các hình thức cơ bản nhất của trí tuệ nhân tạo đã chứng minh được sức mạnh, nhưng việc tạo ra các hệ thống cạnh tranh hoặc vượt trội hơn con người có thể gây tai họa cho loài người.

"Gỉa đòn của trí tuệ nhân tạo sẽ làm thay đổi nó theo máy tự động ở tốc độ ngày càng tăng," ông nói.

Vài tháng sau khi ông qua đời, cuốn sách cuối cùng của Hawking đã được phát hành. Có tựa đề "Câu trả lời đến những câu hỏi lớn," quyển sách của ông cung cấp cho độc giả các câu trả lời cho những câu hỏi ông thường được hỏi. Cuốn sách khoa học nói về lập luận của Hawking chống lại sự tồn tại của Chúa, cách mà con người sẽ có thể sống trong không gian một ngày, và nỗi sợ của ông về kỹ thuật di truyền và lạnh lùng toàn cầu.

Trí tuệ nhân tạo cũng nằm trong danh sách những "câu hỏi lớn" của ông, ông lập luận rằng máy tính "có thể vượt qua con người về trí tuệ" trong vòng 100 năm nữa.

"Chúng ta có thể đối mặt với một sự bùng nổ trí tuệ cuối cùng dẫn đến những thử thách vượt xa trí tuệ của chúng ta," ông viết.

Ông lập luận rằng máy tính cần được đào tạo để đáp ứng các mục tiêu của con người, và khuyến cáo rằng không lấy những rủi ro liên quan đến trí tuệ nhân tạo một cách nghiêm túc có thể là "sai lầm tồi tệ nhất của chúng ta."

Lời nhận xét của Hawking phản ánh những mối quan ngại của cả Elon Musk và cộng sự Steve Wozniak trong một bức thư được phát hành vào tháng 3 năm nay. Hai nhà lãnh đạo công nghệ này, cùng với hàng ngàn chuyên gia khác, đã ký thư kêu gọi tạm dừng ít nhất 6 tháng trong việc xây dựng các hệ thống trí tuệ nhân tạo mạnh hơn chatbot GPT-4 của OpenAI.

"Các hệ thống trí tuệ nhân tạo có trí thông minh tương đương với con người có thể đặt ra những mối nguy hiểm đáng kể đối với xã hội và nhân loại, như được chỉ ra bởi nghiên cứu sâu sát và được công nhận bởi các phòng thí nghiệm trí tuệ nhân tạo hàng đầu," thư ký của Future of Life viết.

Google đang cố gắng cải tiến công cụ tìm kiếm của mình và thậm chí tạo ra một công cụ tìm kiếm mới dựa trên trí tuệ nhân tạo; Microsoft đã tung ra công cụ tìm kiếm "Bing mới" được miêu tả là "trợ lý AI cho web"; và Musk cho biết ông sẽ phát hành một hệ thống trí tuệ nhân tạo đối thủ mà ông mô tả là "khả năng tìm kiếm sự thật tối đa."

Trong năm trước khi qua đời, Hawking khuyến cáo rằng thế giới cần "học cách chuẩn bị và tránh xa các rủi ro tiềm ẩn" liên quan đến trí tuệ nhân tạo, lập luận rằng các hệ thống "có thể là sự kiện tồi tệ nhất trong lịch sử nền văn minh của chúng ta." Tuy nhiên, ông cũng nhận thức rằng tương lai vẫn là chưa rõ và trí tuệ nhân tạo có thể có ích cho loài người nếu được đào tạo đúng cách.