"Trí tuệ nhân tạo đang cách mạng hóa lực lượng cảnh sát, đã tích hợp công nghệ tiên tiến vào các cuộc điều tra của họ, nhưng 'xã hội có nghĩa vụ đạo đức để giảm thiểu các hậu quả tiêu cực', một nghiên cứu gần đây cho biết.

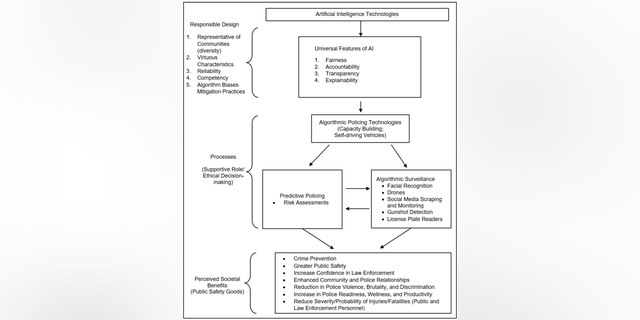

Trí tuệ nhân tạo đang ở độ tuổi thiếu niên, như một số chuyên gia đã nói, nhưng các cơ quan chức năng về an ninh đã tích hợp công nghệ dự đoán trinh sát, nhận dạng khuôn mặt và các công nghệ được thiết kế để phát hiện âm thanh súng vào các cuộc điều tra của họ, theo báo cáo của Đại học North Carolina được công bố vào tháng 2.

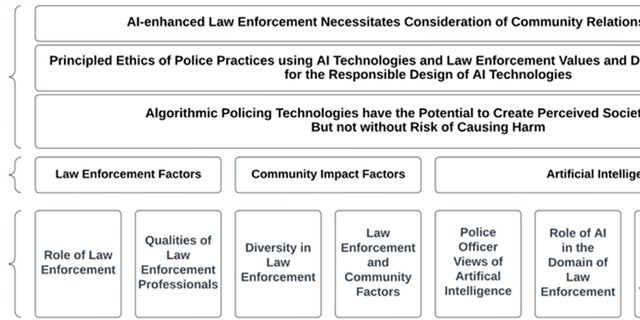

Báo cáo này dựa trên 20 cuộc phỏng vấn nửa cấu trúc của các chuyên gia về an ninh của North Carolina và cách mà trí tuệ nhân tạo tác động đến mối quan hệ giữa cộng đồng và lực lượng cảnh sát.

"Chúng tôi đã phát hiện ra rằng các người tham gia nghiên cứu không quen thuộc với trí tuệ nhân tạo hoặc với các giới hạn của các công nghệ trí tuệ nhân tạo", Jim Brunet, đồng tác giả của nghiên cứu và giám đốc Chương trình Lãnh đạo An ninh Công cộng của NC State cho biết.

"Điều này bao gồm các công nghệ trí tuệ nhân tạo mà các người tham gia đã sử dụng trong công việc, chẳng hạn như các công nghệ nhận dạng khuôn mặt và phát hiện âm thanh súng", ông nói. "Tuy nhiên, các người tham gia nghiên cứu đã bày tỏ sự ủng hộ cho những công cụ này, mà họ cảm thấy có giá trị cho lực lượng cảnh sát".

Các quan chức về an ninh tin rằng trí tuệ nhân tạo sẽ cải thiện an ninh công cộng nhưng có thể làm suy giảm niềm tin giữa cảnh sát và dân thường, theo nghiên cứu.

Điều này đang diễn ra vào thời điểm các thành phố Mỹ đang đấu tranh với vấn đề đầy chính trị của việc ngăn ngừa tội phạm trong khi phục hồi lại niềm tin của công chúng sau vụ án George Floyd bị sát hại bởi các sĩ quan cảnh sát bị sa thải.

Ed Davis, người đã làm trưởng công an trong vụ nổ bom Marathon Boston vào năm 2013, cho biết trên Fox News Digital rằng trí tuệ nhân tạo "sẽ cuối cùng cải thiện các cuộc điều tra và cho phép nhiều phạm nhân nguy hiểm bị đưa ra án".

Nhưng nó đi kèm với những rủi ro và khó khăn, ông Davis nói, và tội phạm sẽ có quyền truy cập vào cùng một công nghệ này, có thể ảnh hưởng tiêu cực đến các cuộc điều tra của cảnh sát".

Những lời nhận xét của ủy viên được tôn trọng được ủng hộ bởi những kết quả nghiên cứu.

"Nên hướng đến việc chính sách được hướng dẫn bởi sự thống nhất của công chúng và cuộc thảo luận hợp tác với các chuyên gia pháp luật nhằm nâng cao trách nhiệm thông qua việc thiết kế trí tuệ nhân tạo có trách nhiệm trong cảnh sát để cung cấp lợi ích xã hội và giảm thiểu thiệt hại đối với người dân," cuộc nghiên cứu kết luận.

"Xã hội có nghĩa vụ đạo đức để giảm thiểu những hệ quả có hại của việc tích hợp đầy đủ các công nghệ trí tuệ nhân tạo vào lực lượng cảnh sát."

Một phần của vấn đề là sự thiếu kiến thức tổng quát về khả năng của trí tuệ nhân tạo và cách chúng hoạt động của cảnh sát, Ronald Dempsey, tác giả đầu tiên của nghiên cứu và là một sinh viên tốt nghiệp trước đây tại Đại học NC. State, cho biết.

Điều đó "làm cho việc đánh giá giới hạn và rủi ro đạo đức trở nên khó khăn hoặc không khả thi đối với họ", Dempsey nói. "Điều đó có thể gây ra vấn đề lớn cho cảnh sát và công chúng."

Việc sử dụng nhận dạng khuôn mặt trong lực lượng cảnh sát tăng mạnh sau vụ bạo loạn Quốc hội ngày 6/1/2021.

Trong số 42 cơ quan liên bang mà Tổng vụ trách nhiệm Chính phủ khảo sát vào năm 2021, 20 cơ quan báo cáo họ sử dụng nhận dạng khuôn mặt trong các điều tra tội phạm.

Nếu các công nghệ trí tuệ nhân tạo mới xuất hiện "được quy định kỹ càng và triển khai cẩn thận", tiện ích an ninh công cộng "có thể tiềm năng nâng cao niềm tin cộng đồng đối với cảnh sát và hệ thống tư pháp hình sự," nghiên cứu phát hiện.

"Tuy nhiên, người tham gia nghiên cứu đề cập đến mối lo ngại đối với nguy cơ thiên hạch thuật toán (những thách thức tính đa dạng và đại diện), khó khăn trong việc tái hiện yếu tố con người về sự đồng cảm và mối quan tâm về sự riêng tư và niềm tin.

"Ngoài ra, những thách thức về sự công bằng, trách nhiệm, minh bạch và khả năng giải thích vẫn tồn tại như đã được trình bày trong cuộc tranh luận học thuật rộng hơn," nghiên cứu cho biết.

AI có khả năng kết nối hoặc làm sâu sắc khoảng cách giữa cảnh sát và công chúng, theo nghiên cứu, và nó cho biết rằng rất cần thiết để người lãnh đạo cảnh sát có một chỗ ngồi trong tất cả các cuộc thảo luận về khuôn khổ cho phép cảnh sát sử dụng công nghệ này.

Veljko Dubljević, tác giả tương ứng của nghiên cứu và giáo sư phụ trách tại Đại học North Carolina State, nói rằng các hướng dẫn có thể được sử dụng để thông tin quyết định trí tuệ nhân tạo.

"Đồng thời, cũng quan trọng để hiểu rằng các công cụ trí tuệ nhân tạo không phải là hoàn hảo", Dubljević nói. "Trí tuệ nhân tạo phụ thuộc vào giới hạn. Và nếu các nhà chức trách cảnh sát không hiểu rõ các giới hạn đó, họ có thể đặt nhiều giá trị hơn vào trí tuệ nhân tạo so với điều đó xứng đáng - điều đó có thể đặt ra thách thức đạo đức trong chính nó."

NGUY CƠ CỦA TRÍ TUỆ NHÂN TẠO LÀ GÌ?

Cảnh sát đã mắc sai lầm khi sử dụng công nghệ nhận diện khuôn mặt dẫn đến các vụ bắt giữ sai lầm.

Các thuật toán trí tuệ nhân tạo đã nhầm lẫn trong việc nhận dạng khuôn mặt da đen và da Á gấp từ 10 đến 100 lần so với khuôn mặt da trắng, theo một nghiên cứu năm 2019 của Viện Tiêu chuẩn và Công nghệ Quốc gia.

"Bao giờ cũng có nguy cơ khi cảnh sát áp dụng những công nghệ không được phát triển với mục đích cho cảnh sát", Brunet nói.

"Điều này đặc biệt đúng với các công nghệ trí tuệ nhân tạo như nhận dạng khuôn mặt. Vì vậy, điều quan trọng là các quan chức cảnh sát phải được đào tạo về các khía cạnh đạo đức xung quanh việc sử dụng các công nghệ trí tuệ nhân tạo này."

HOA KỲ, LIÊN MINH CHÂU ÂU VÀ TRUNG QUỐC LÀM CÁCH NÀO ĐỂ QUY ĐỊNH CÁC CÔNG TY PHẦN MỀM TRÍ TUỆ NHÂN TẠO?

Nghiên cứu nhấn mạnh cần tạo ra một văn hóa minh bạch về trách nhiệm để cho thấy những công nghệ trí tuệ nhân tạo được sử dụng trong điều tra của cảnh sát.

Một bài báo gần đây trên New York Times về vụ bắt giữ sai lầm dựa trên nhận diện khuôn mặt chỉ ra các tài liệu tòa án và báo cáo cảnh sát không đề cập đến việc sử dụng công nghệ trí tuệ nhân tạo, một thực hành được cho là đang trở nên phổ biến hơn.

"Lần cuối cùng, các công nghệ trí tuệ nhân tạo trong lĩnh vực cảnh sát phải được giải thích, ít nhất là nói chung, về cách đạt được quyết định", nghiên cứu của Thành phố NC nói.

"Chuyên môn trong lĩnh vực cảnh sát nên đào tạo về các công nghệ trí tuệ nhân tạo được sử dụng trong lĩnh vực và toàn bộ hệ thống tư pháp hình sự. Đào tạo thủ tục cho các sĩ quan cảnh sát sử dụng công nghệ trí tuệ nhân tạo."

CLICK VÀO ĐÂY ĐỂ TẢI ỨNG DỤNG FOX NEWS

Nghiên cứu tập trung vào Bắc Carolina và được thiết kế như một "bức tranh tổng thể" của một xu hướng mới nổi và đòi hỏi thêm nghiên cứu và giáo dục cho các chuyên gia cảnh sát.