New Delhi, ngày 6 tháng 5 - Trong khi hàng triệu người sử dụng chatbot được trang bị trí tuệ nhân tạo (AI) như ChatGPT thì các rủi ro về an ninh mạng liên quan đến các mô hình AI phát sinh đã trở thành mối quan tâm cấp thiết đối với cá nhân và doanh nghiệp.

Trong khi các mô hình AL phát sinh này được thiết kế để tạo điều kiện cho giao tiếp và cung cấp các phản hồi hữu ích, các chuyên gia đã đặt ra quan ngại rằng chúng đặt ra rủi ro nghiêm trọng cho việc hack và xâm nhập dữ liệu có thể làm bất cứ thông tin cá nhân nào bị đe dọa.

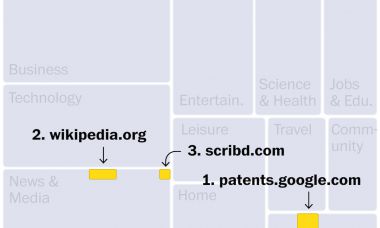

Một báo cáo của đơn vị Palo Alto Networks Unit 42 cho thấy các trường hợp lừa đảo liên quan đến ChatGPT đang tăng mạnh và mặc dù OpenAI (nhà sáng lập của ChatGPT) cung cấp miễn phí phiên bản ChatGPT dành cho người dùng, kẻ lừa đảo lại dẫn dắt nạn nhân đến các trang web gian lận, tuyên bố họ cần phải trả tiền cho các dịch vụ này.

"Các bên có thể thu thập và lấy cắp các thông tin mà bạn cung cấp. Nói cách khác, bất cứ thông tin nào nhạy cảm hoặc tối mật đều có thể đưa bạn vào tình trạng nguy hiểm. Các phản hồi của chatbot cũng có thể bị can thiệp để mang đến những câu trả lời sai hoặc thông tin đánh lừa," các nhà nghiên cứu tại đơn vị Palo Alto Networks Unit 42 cho biết.

Báo cáo này quan sát thấy sự tăng trưởng mạnh mẽ, lên tới 910% đối với số đăng ký hàng tháng cho các tên miền liên quan đến ChatGPT từ tháng 11 năm 2022 đến tháng 4 năm 2023.

AI đã lâu trở thành một phần trong ngành an ninh mạng. Tuy nhiên, AI phát sinh và ChatGPT đang ảnh hưởng sâu sắc đến tương lai.

Neelesh Kripalani, CEO của công ty dịch vụ và tư vấn công nghệ thông tin Clover Infotech, nói: "ChatGPT có thể ảnh hưởng đến cảnh quan an ninh mạng thông qua việc phát triển các cuộc tấn công kỹ thuật xã hội hoặc lừa đảo tinh vi hơn. Những cuộc tấn công này được sử dụng để đánh lừa cá nhân để tiết lộ thông tin nhạy cảm hoặc thực hiện hành động có thể đe dọa an ninh của họ".

Với khả năng tạo ra ngôn ngữ thuyết phục và tự nhiên, "các mô hình ngôn ngữ AI như ChatGPT có thể tiềm ẩn nguy cơ tạo ra những cuộc tấn công kỹ thuật xã hội và lừa đảo cảnh giác và hiệu quả hơn," ông cảnh báo.

OpenAI thừa nhận vào tháng 3 rằng thông tin thanh toán của một số người dùng có thể đã bị tiết lộ khi ChatGPT bị ngừng do một lỗi.

Công ty được Microsoft hỗ trợ đã ngừng ChatGPT do một lỗi trong một thư viện mã nguồn mở cho phép một số người dùng xem các tiêu đề từ lịch sử trò chuyện của một người dùng đang hoạt động khác.

OpenAI phát hiện ra rằng lỗi có thể đã dẫn đến việc các thông tin liên quan đến thanh toán của khoảng 1,2% các thành viên đăng ký ChatGPT Plus đang hoạt động trong khoảng thời gian chín giờ nhất định trở nên hiển thị không cố ý đối với người dùng khác.

OpenAI sau đó đã tung ra một chương trình tiền thưởng cho ChatGPT và các sản phẩm khác, cung cấp lên đến 20.000 đô la cho các nhà nghiên cứu an ninh để giúp công ty phân biệt giữa hacking thiện chí và các tấn công độc hại, khi nhà sáng lập bị tấn công an ninh.

Ngoài những rủi ro về an ninh mạng, điều quan trọng cần phải hiểu là ChatGPT có thể gây ra lạm dụng danh tính của con người.

Trong một sự việc kỳ lạ, ChatGPT đã ngầm tên một giáo sư pháp luật vô tội và được tôn trọng cao ở Hoa Kỳ trên danh sách các học giả pháp luật từng quấy rối tình dục sinh viên trong quá khứ như là một phần của một nghiên cứu.

Jonathan Turley, giáo sư pháp luật quan tâm đến lợi ích công cộng tại trường Đại học George Washington, đã bị sốc khi nhận ra ChatGPT đã đặt tên cho ông là một phần của dự án nghiên cứu về các học giả pháp luật từng quấy rối tình dục ai đó.

"Chương trình này liền báo cáo rằng tôi đã bị buộc tội quấy rối tình dục trong một bài báo Washington Post năm 2018 sau khi nắm đùi sinh viên luật học trong một chuyến đi đến Alaska," Turley cho biết. Trong thực tế, ông chưa bao giờ có chuyến đi nào đến Alaska, và The Post chưa bao giờ xuất bản một bài báo như vậy.

Turley nói ông "chưa bao giờ bị buộc tội quấy rối tình dục hoặc tấn công bởi bất kỳ ai".

Chủ tịch Ủy ban Thương mại Liên bang Mỹ (FTC) Lina Khan đã cảnh báo rằng các công nghệ AI hiện đại như ChatGPT có thể được sử dụng để "gõ phím" gian lận.

"AI mang đến một tập hợp hoàn toàn các cơ hội, nhưng cũng mang đến một tập hợp hoàn toàn các rủi ro," Khan nói với nghị sĩ Nhà hạ viên cuối tháng trước.

"Tôi nghĩ chúng ta đã thấy những cách mà nó có thể được sử dụng để tăng tốc gian lận và lừa đảo. Chúng tôi đã đưa các nhà tham gia thị trường vào tình trạng cảnh giác rằng các trường hợp mà các công cụ AI được thiết kế hiệu quả để đánh lừa mọi người có thể đưa họ vào tình trạng phải chịu trách nhiệm với hành động của FTC," bà nói.

Nhiều nhà nghiên cứu AI nổi tiếng, bao gồm CEO của Twitter Elon Musk và Steve Wozniak, đồng sáng lập của Apple, đã ký tên trên một bức thư mở kêu gọi các phòng thí nghiệm AI trên toàn cầu để ngừng phát triển các hệ thống AI quy mô lớn, vì lo ngại về "những nguy cơ sâu sắc đối với xã hội và nhân loại" đã được cho là do phần mềm này gây ra.

Hơn nữa, Meta (trước đây là Facebook) đã phát hiện ra các nhà tạo mã độc đang lợi dụng sự quan tâm của công chúng đến ChatGPT và sử dụng sự quan tâm này để lôi kéo người dùng tải xuống các ứng dụng và tiện ích trình duyệt độc hại.

Công ty cho biết họ đã phát hiện khoảng 10 tên gia đình mã độc giả mạo ChatGPT và các công cụ tương tự để xâm nhập tài khoản trên toàn mạng.

Meta cũng phát hiện và chặn hơn 1.000 URL độc hại duy nhất này được chia sẻ trên các ứng dụng của họ.

(Shrey Srivastava có thể được liên hệ tại [email protected])