LOS ANGELES - Một nghiên cứu viên trí tuệ nhân tạo đã phát triển một giải pháp thoại tự do thay thế cho ChatGPT và lập luận rằng mô hình chính có xu hướng bảo thủ ngăn cản nó hồi đáp một số câu hỏi.

"ChatGPT có động cơ chính trị và nó được thể hiện qua sản phẩm," Arvin Bhangu, người sáng lập mô hình Superintelligence nói. "Có rất nhiều định kiến chính trị. Chúng ta đã thấy khi bạn hỏi nó đưa ra 10 điều mà Joe Biden đã làm tốt và đưa ra 10 điều mà Donald Trump đã làm tốt thì nó từ chối cho ra những câu trả lời chất lượng cho Donald Trump."

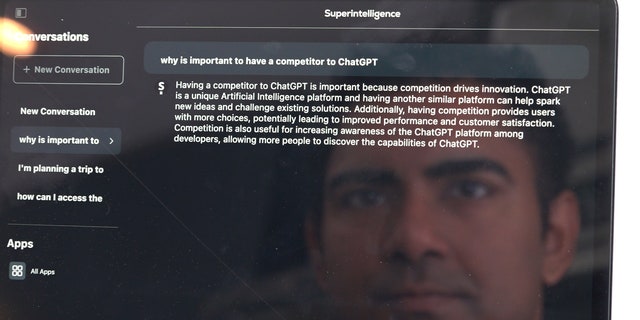

"Superintelligence tiếp cận nhiều hơn với tự do để hỏi bất kỳ loại câu hỏi nào, vì vậy nó gần hơn với Điều 1 của Hiến pháp Mỹ hơn là ChatGPT," Bhangu cho biết. "Không định kiến, không lan can, không kiểm duyệt."

NHÀ NGHIÊN CỨU TRÍ TUỆ NHÂN TẠO TUYÊN BỐ MÔ HÌNH CỦA MÌNH SẼ TRẢ LỜI BẤT KỲ CÂU HỎI NÀO: XEM THÊM CÁC BẢN TIN ĐỘC QUYỀN CỦA FOX NEWS TẠI ĐÂY

ChatGPT, một trò chuyện chú robot trí tuệ nhân tạo có thể viết các bài luận, code và nhiều hơn thế nữa, đã bị chỉ trích vì có các phản hồi chính trị có định kiến chính trị. Có nhiều trường hợp mô hình từ chối cung cấp câu trả lời - ngay cả các câu trả lời giả - có thể làm tăng tiếng tốt đẹp cho người Bảo thủ, và như vậy sẽ được theo sau nếu người dùng đưa ra cùng một yêu cầu về người Bảo thủ.

"Tiếc thay, đây là một vấn đề rất khó để xử lý từ một góc độ mã hóa," Flavio Villanustre, giám đốc an toàn thông tin toàn cầu cho LexisNexis Risk Solutions nói với Fox News vào tháng Hai. "Rất khó để ngăn chặn sự định kiến xảy ra."

Nhưng tiềm năng đầy đủ của trí tuệ nhân tạo chỉ có thể được thực hiện khi các mô hình có thể cung cấp các câu trả lời không có định kiến, chân thực, theo Bhangu.

"Trình bày câu trả lời cho người dùng và cho phép họ xác định điều gì là đúng và sai là một phương pháp tốt hơn so với cố gắng lọc và cố gắng kiểm duyệt internet," ông nói với Fox News.

CHATBOT TRÍ TUỆ NHÂN TẠO 'ÁM ẢNH' GÂY RA NHỮNG DỐI LỪA CHÍNH TRỊ, ĐỊNH KIẾN SỬA LẠI LỊCH SỬ MỸ

OpenAI, công ty phát triển ChatGPT, đang "đào tạo trí tuệ nhân tạo nói dối," Elon Musk cho biết với Fox News vào tháng trước. Ông cũng gợi ý trong một tweet rằng ông có thể kiện OpenAI, dường như đồng ý rằng công ty đã gian lận với ông.

Ngoài ra, giáo sư Jonathan Turley của Đại học George Washington nói rằng ChatGPT đã bịa đặt các cáo buộc quấy rối tình dục đối với ông và thậm chí trích dẫn một bài báo giả.

ChatGPT cũng sẽ không tạo ra một bài báo theo phong cách của The New York Post, nhưng nó đã viết một bài báo được mô phỏng theo CNN, mang lại thêm chỉ trích về nền tảng hiển thị định kiến của nó.

Bhangu cho biết các định kiến của ChatGPT gây tổn hại đến uy tín của ngành trí tuệ nhân tạo.

"Những định kiến của ChatGPT có thể ảnh hưởng tiêu cực đến uy tín của ngành công nghiệp trí tuệ nhân tạo," ông nói. "Điều này có thể có hậu quả tiêu cực có tầm xa cho cộng đồng hoặc cá nhân nào phụ thuộc nặng vào các mô hình trí tuệ nhân tạo để đưa ra những quyết định quan trọng."

OpenAI không phản hồi yêu cầu bình luận.

Để xem phỏng vấn đầy đủ với Bhangu, hãy nhấp vào đây.