Trong ảnh minh họa này, logo của ChatGPT - một chatbot được phát triển bởi OpenAI, được nhìn thấy trên một điện thoại thông minh trong tay (Ảnh minh họa bởi Pavlo Gonchar/SOPA Images/LightRocket qua Getty Images).

Hình ảnh của SOPA Images/LightRocket qua Getty Images. Một luật sư đang đại diện cho một người đàn ông trong một vụ kiện chấn thương cá nhân tại Manhattan đã nộp đơn cho tòa án. Luật sư đã làm sai điều gì? Ông đã trình bày một tài liệu tại tòa liên bang mà trích dẫn ít nhất sáu vụ án không tồn tại. Thật đáng tiếc, luật sư đã sử dụng chatbot AI ChatGPT, mà hoàn toàn phát minh ra các vụ án bằng tay trống.

Luật sư trong vụ kiện, Steven A. Schwartz, đang đại diện cho một người đàn ông kiện Avianca Airlines sau khi một chiếc xe đẩy phục vụ tại máy bay đã chạm vào đầu gối anh ta vào năm 2019. Schwartz cho biết ông chưa bao giờ sử dụng ChatGPT trước đó và không có ý định rằng nó sẽ phát minh ra các vụ kiện.

Thực tế, Schwartz đã hỏi ChatGPT liệu các vụ án có thật hay không. Chatbot khẳng định rằng chúng có thật. Nhưng chỉ sau khi các luật sư của hãng hàng không chỉ ra trong một đơn mới rằng các vụ án không tồn tại, Schwartz mới phát hiện ra lỗi của mình. (Hoặc của máy tính, tùy thuộc vào cách bạn hiểu.)

Chánh án trong vụ án, P. Kevin Castel, sẽ tổ chức một phiên điều trần vào ngày 8 tháng 6 để quyết định điều gì trong vòng lưới phức tạp này, theo Tờ New York Times. Nhưng không cần nói rằng, chánh án không hài lòng.

ChatGPT được ra mắt vào cuối năm 2022 và ngay lập tức trở thành một trào lưu. Chatbot là một phần của một gia đình các công nghệ mới được gọi là Generative AI có thể giữ cuộc trò chuyện với người dùng trong vài giờ liền. Những cuộc đối thoại cảm giác rất hữu nghị và tự nhiên đến nỗi đôi khi ChatGPT sẽ có vẻ như có một tâm trí riêng. Nhưng công nghệ này rất chính xác và thường sẽ chỉ phát minh ra những sự thật và nguồn gốc mà hoàn toàn giả tạo. Sản phẩm đối thủ của Google là Bard cũng gặp phải các vấn đề tương tự.

Nhưng không có vấn đề nào ngăn cản con người sử dụng công nghệ thử nghiệm này như là một nguồn thông tin đáng tin cậy. Có vô số các báo cáo về trẻ em sử dụng ChatGPT để viết các bài luận cho họ, và cũng có nhiều thông tin về giáo viên nghĩ rằng họ có thể chỉ cần hỏi ChatGPT liệu một bài luận đã được sử dụng hay không. OpenAI, công ty phát triển ChatGPT, cung cấp một dịch vụ cố gắng phát hiện khi chatbot AI đã được sử dụng, nhưng bộ phát hiện đó được cho là chỉ có mức độ chính xác 20%. Và nếu bạn chỉ cần cho ChatGPT một đoạn văn bản ngẫu nhiên, trí thông minh nhân tạo không thể cho bạn biết nó đã viết chúng. Tôi đã tự thử nghiệm điều này vào đầu tháng này và ChatGPT vẫn tiếp tục nhận các tác phẩm của người khác.

Các chatbot như ChatGPT gây tranh cãi vì nhiều lý do, bao gồm thực tế rằng một số chuyên gia công nghệ lo lắng AI có thể trở nên quá vô lý. Một số người thậm chí tin rằng AI có thể bắt đầu có ý chí của riêng nó, gây ra một kịch bản tương tự Terminator, trong đó nhân loại hoàn toàn bị hủy diệt. Tỷ phú Elon Musk đã nhá hàng một khả năng như vậy khi ông gần đây kêu gọi một đình chỉ sáu tháng về việc phát triển AI - một đình chỉ có thể liên quan đến việc ông đang đua để xây dựng một sản phẩm đối thủ của ChatGPT riêng của mình. Musk từng là một trong những người sáng lập của OpenAI vào năm 2015 trước khi ông bị đẩy ra khỏi công ty trong năm 2018 sau khi cố gắng kiểm soát công ty.

Tuy nhiên, chúng ta vẫn chưa gần đến lúc máy móc kéo đổ đại địa sinh vật. Chatbot như ChatGPT chỉ là phiên bản tiên tiến hơn của văn bản dự đoán. Chatbot hoạt động bằng cách cố gắng đoán xem nên nói gì với tốc độ đáng kinh ngạc, và tốc độ đó thường xuyên khiến nó phát ra rất nhiều thông tin không chính xác. Thay vì chỉ nói "Tôi không biết", công nghệ sẽ tạo ra một danh sách dài các nguồn không thực sự tồn tại. Và nếu bạn hỏi ChatGPT liệu các nguồn đó có thực sự tồn tại, nó sẽ đảm bảo rằng chúng có.

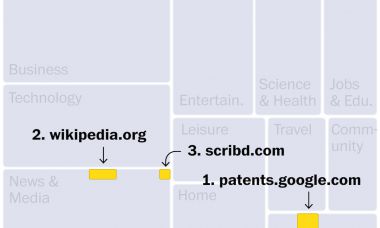

Con người đã quá ưa chuộng Google, một công cụ tìm kiếm không hoàn hảo nhưng sẽ cố gắng tìm và hiển thị thông tin chính xác nhất. Wikipedia, ban đầu gặp sự hoài nghi khi ra mắt, nhưng là một nguồn tin đáng tin cậy chung vì liên tục được kiểm soát bởi đội ngũ chuyên gia quan tâm đến việc đưa ra thông tin chính xác. ChatGPT không quan tâm liệu thông tin nó đưa ra có chính xác hay không. Đó chỉ là một màn ảo thuật và những người đã tìm thấy các dịch vụ thông tin chính thống như Google và Wikipedia đều chính xác sẽ có một trải nghiệm khó chịu. Vì những công cụ công nghệ thế hệ mới này không quan tâm đến sự thật. Chúng được thiết kế để đồng cảm không để chính xác. Và người dùng internet sẽ tiếp tục học bài học đau đớn đó khi AI được nhúng vào nhiều công nghệ chúng ta sử dụng hàng ngày.

Sự nguy hiểm của trí tuệ nhân tạo có thể không nằm ở vào một công nghệ phát triển riêng của nó. Nguy hiểm thực sự, có vẻ như là con người đơn giản chỉ tin tưởng mọi thứ mà máy móc nói, dù có sai lầm đến đâu. ChatGPT không biết nó đang truyền tải thông tin không chính xác cho bạn. Vì vậy, chúng ta phải kiểm tra sự chính xác của các sự kiện và quan tâm đến việc đưa ra các thông tin chính xác.