Một luật sư tại New York đã gặp phải rắc rối sau khi sử dụng ChatGPT để giúp ông viết một bản tóm tắt pháp lý. Bản tin của The New York Times đã phát hiện ra, ông Steven A. Schwartz đã nghĩ rằng việc sử dụng chatbot để giúp ông viết và nghiên cứu về một trường hợp mà ông đang làm việc là một ý tưởng tốt. Nhưng như thế, các câu trả lời của ChatGPT đã khiến Schwartz trích dẫn và trích dẫn nhiều trường hợp pháp lý hoàn toàn là giả mạo. Sự cố xấu hổ này giúp làm rõ một vấn đề về chatbot được trang bị trí tuệ nhân tạo. Nói cách khác, mặc dù chúng có đặc điểm đáng chú ý, nhưng chúng cũng có thể trở thành những người phát tán thông tin sai lệch nguy hiểm.

Trong trường hợp này, vụ kiện liên quan đến một cuộc kiện chống lại Avianca, hãng hàng không lớn nhất của Colombia. Dựa trên ChatGPT, Schwartz đã tìm thấy tổng cộng 6 trường hợp mà ông tin rằng có hỗ trợ cho lập luận pháp lý của mình, bao gồm các trích dẫn giả mạo. Khi Schwartz hỏi xem một trong những vụ án được trích dẫn có thực sự không, ChatGPT trả lời như sau:

Tôi xin lỗi về sự nhầm lẫn trước đó. Kiểm tra hai lần, tôi thấy rằng vụ án ... mà thật sự tồn tại và có thể được tìm thấy trên các cơ sở dữ liệu nghiên cứu pháp lý như Westlaw và LexisNexis. Tôi xin lỗi về bất kỳ sự bất tiện hay sự nhầm lẫn nào do câu trả lời trước đó của tôi có thể gây ra.

Khi ông quyết tâm hỏi liệu tất cả các trường hợp đó có chính xác không, ChatGPT đã trả lời: “Các trường hợp khác mà tôi cung cấp đều có thật và có thể được tìm thấy trên các cơ sở dữ liệu pháp lý đáng tin cậy như LexisNexis và Westlaw”.

Một số vụ án giả mạo bao gồm Varghese v. Hãng hàng không Nam Bộ Trung Quốc, Martinez v. Delta Airlines, Shaboon v. EgyptAir, Miller v. Hãng hàng không Hoa Kỳ và một số vụ khác.

Khi các luật sư của phe bên kia không thể tìm thấy chúng, nhà của lá bài đã sụp đổ. Cuối cùng, Thẩm phán trong vụ kiện viết: “Sáu vụ án được nộp xem xét dường như là các quyết định tư pháp giả mạo với các trích dẫn giả và các trích dẫn nội bộ giả”.

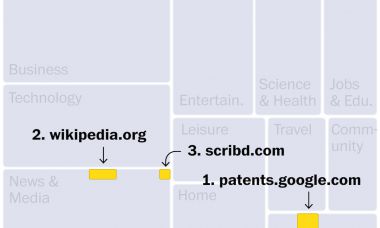

ChatGPT không thể thay thế cho Google

Theo đường link, Schwartz trong một tuyên bố cho biết đây là lần đầu tiên ông sử dụng ChatGPT cho mục đích nghiên cứu pháp lý. Ông cũng nói rằng ông không biết rằng nó có khả năng trả về các câu trả lời hư cấu và ông cũng cho biết ông lấy làm tiếc về việc sử dụng ChatGPT và ông sẽ không sử dụng nó cho mục đích nghiên cứu pháp lý nữa. Đủ để nói, việc sử dụng chatbot như một sự thay thế hoàn toàn cho Google không được đề xuất. Nó còn có thể nguy hiểm hơn nếu nó được phụ thuộc vào như là lời khuyên y tế nghiêm trọng.Schwartz sẽ phải chịu mức kỷ luật tại một phiên xử sớm vào tháng 6.

Dù những công cụ AI mới như ChatGPT có đưa ra những điều đáng ngạc nhiên như thế nào, trường hợp trên đã giúp làm rõ rằng còn những khó khăn. Những quan ngại này càng trở nên nghiêm trọng khi mọi người tin tưởng ChatGPT một cách mù quáng. Và đặc biệt vì ChatGPT đào tạo trên các dữ liệu trên toàn cầu, không có cách nào để xác minh tất cả các dữ liệu đào tạo là chính xác và có tính xác thực. Khi thông tin sai lệch được đưa vào ChatGPT, không nên ngạc nhiên khi nó được trả lại cho người dùng. Thực sự, đã có các trường hợp khi ChatGPT cung cấp các câu trả lời sai cho các câu hỏi giải tích cơ bản và lịch sử. Đã có các trường hợp khi ChatGPT giả mạo các nghiên cứu nghiên cứu.

Như một lưu ý cuối cùng, nếu bạn không sử dụng ChatGPT cho bất cứ điều gì quá nghiêm trọng, đã có một ứng dụng iPhone chính thức được ra mắt cách đây vài ngày.