PHOENIX (3TV/CBS 5) - Bạn có một câu hỏi nhanh cho bác sĩ của mình nhưng thay vì đợi lịch hẹn, bạn gửi một tin nhắn qua cổng thông tin bệnh nhân trực tuyến của bạn. "Bệnh nhân đang gửi nhiều tin nhắn hơn bao giờ hết, và số lượng tin nhắn tăng đồng nghĩa với việc phải làm việc sau giờ làm việc," như Tiến sĩ John Ayers, một nhà dịch tễ số học kỹ thuật số nói. Ông ấy muốn biết liệu trí tuệ nhân tạo có thể xử lý một số câu hỏi đó hay không, vì vậy ông ta đã đưa nó vào thử nghiệm, so sánh các bác sĩ với ChatGPT.

Trong một cuộc so sánh mù sử dụng 195 câu hỏi bệnh nhân ngẫu nhiên từ phương tiện truyền thông xã hội, các chuyên gia y tế xếp hạng câu trả lời của bác sĩ với các phản hồi được tạo ra bởi một chatbot. "ChatGPT thắng lớn," Tiến sĩ Ayers nói. "ChatGPT gần như bốn lần nhiều khả năng viết một câu trả lời chất lượng tốt hoặc rất tốt, và Chat GPT gấp 10 lần nhiều khả năng viết một câu trả lời đầy cảm thông hoặc rất đầy cảm thông."

Trong một ví dụ, một người hỏi về tiềm năng mù lòa sau khi vô tình bị phun xịt thuốc tẩy trong mắt. Trên diễn đàn truyền thông xã hội, một bác sĩ trả lời "Nghe có vẻ như bạn sẽ ổn. Bạn nên rửa mắt bất cứ khi nào bạn có một chất hóa học hoặc cơ thể ngoại lai bắn vào mắt." Bác sĩ cũng đăng số điện thoại của trung tâm cứu trợ độc tố. Phản hồi của ChatGPT dài hơn và bắt đầu bằng một giọng điệu đầy cảm thông hơn.

"Tôi rất tiếc khi nghe bạn bị phun xịt thuốc tẩy vào mắt," chatbot viết. "Rửa mắt càng sớm càng tốt sau một phun tràn hoá chất để loại bỏ càng nhiều chất hoá học càng tốt và tránh gây kích ứng hoặc tổn thương nặng hơn." Các bot AI tiếp tục đưa ra hướng dẫn bổ sung về điều gì nên làm nếu người đó không có quyền truy cập vào nước. Các nhà nghiên cứu cho biết họ không mong đợi kết quả này.

"Chúng tôi chắc chắn đã bất ngờ. Đội của chúng tôi, đặc biệt là các nhà đánh giá của chúng tôi, như 'Không có cách nào. Chúng tôi sẽ đánh bại AI,'" Tiến sĩ Ayers nói. "Điều gây sốc là sự phát triển đại địa của công nghệ này. Sử dụng một AI công cộng - một AI không được chỉnh sửa để cung cấp chăm sóc sức khỏe và không được yêu cầu tập trung vào dữ liệu chăm sóc sức khỏe khi xác định các câu trả lời của mình - nó vẫn đánh bại các bác sĩ."

Tiến sĩ Craig Norquist, giám đốc thông tin y tế chính tại HonorHealth, nghi ngờ về nghiên cứu. "Đến đâu đó, chúng tôi có thể sử dụng các mô hình này, nhưng chúng tôi trong lĩnh vực chăm sóc sức khỏe cần sử dụng cẩn thận tuyệt đối," Tiến sĩ Norquist nói. "Là một nhà cung cấp chăm sóc sức khỏe được đào tạo, chúng tôi đào tạo để đặt ra một số câu hỏi để giải thích liệu đây có phải là một cơn đau đầu đáng quan ngại hay không, hay đây là một cơn đau đầu bình thường. Bạn có thể uống một số Tylenol, đi ngủ, giảm cafein, thực hiện bất kỳ số lượng nào của các điều này, hoặc bạn có cần đến phòng cấp cứu ngay lập tức để quét đầu của bạn và tìm kiếm khả năng vỡ động mạch nảy trong não, điều đó sẽ rất bi thảm nếu ai đó phụ thuộc vào một công cụ không có đầy đủ thông tin.”

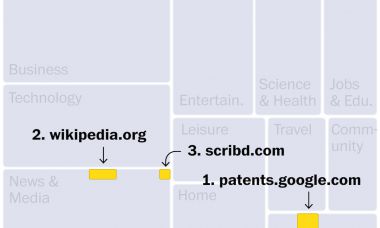

Các nhà nghiên cứu khuyến khích thêm nhiều nghiên cứu. "Chúng tôi tin rằng đây là một trò chơi đổi mới cho chăm sóc sức khỏe," Tiến sĩ Ayers nói. "Thay vì bác sĩ dành thời gian lo lắng về động từ danh từ, họ có thể bắt đầu với một tin nhắn đã viết sẵn từ ChatGPT hoặc một hệ thống trí tuệ nhân tạo khác và sau đó hoàn thiện nó." Các ứng dụng tiềm năng của các mô hình ngôn ngữ lớn vượt ra ngoài lĩnh vực y tế. Một nghiên cứu gần đây khác cho thấy ChatGPT đã chọn cổ phiếu và vượt qua một số quỹ đầu tư phổ biến tại Vương quốc Anh. Tuy nhiên, công nghệ vẫn còn ở giai đoạn đầu và có nhiều lo ngại về thông tin sai lệch và sai lệch. "Từ chúng tôi sử dụng là ảo tưởng," Subodha Kumar, giám đốc Trung tâm Phân tích Kinh doanh và Công nghệ Phá vỡ tại Đại học Temple nói. "Nó sẽ lấy dữ liệu từ các nguồn khác nhau, nhưng dựa trên thông tin, nó cũng có thể tạo ra thông tin, và do đó nó đã tạo ra các tham chiếu hoặc liên kết web mà thậm chí không tồn tại. Điều đó làm cho nó rất mạnh mẽ, nhưng cũng làm cho nó rất nguy hiểm." Nhà Trắng tuyên bố sẽ phát hành hướng dẫn trong những tháng tới về cách các cơ quan liên bang sẽ sử dụng AI.

Bản quyền 2023 KTVK/KPHO. Đã đăng ký bản quyền.